時至2025,大部分職場打工人的生產力神器排行榜中,AI應用早已狠狠超越計算機跟Office軟體了,其中又以大語言模型(LLM)最為普及。不過,世界上能用來訓練次世代模型的數位文字,早已被使用殆盡,於是「人類與LLM的對話紀錄」就成了各LLM大廠最覬覦的寶藏了。

身為LLM重度使用者的我,也擔心自己是否為了效率與便利,不知不覺出賣了自己的資料。正如駭客任務中人類淪為電池的角色,現在的我似乎只是改為提供「新鮮的文字」。亡羊補牢,時猶未晚,於是讓ChatGPT的深入研究功能,幫我徹底檢視七個常用LLM的隱私政策與設定,還簡易評了個「隱私捍衛指數」。

如果你不付錢,那麼你就是產品

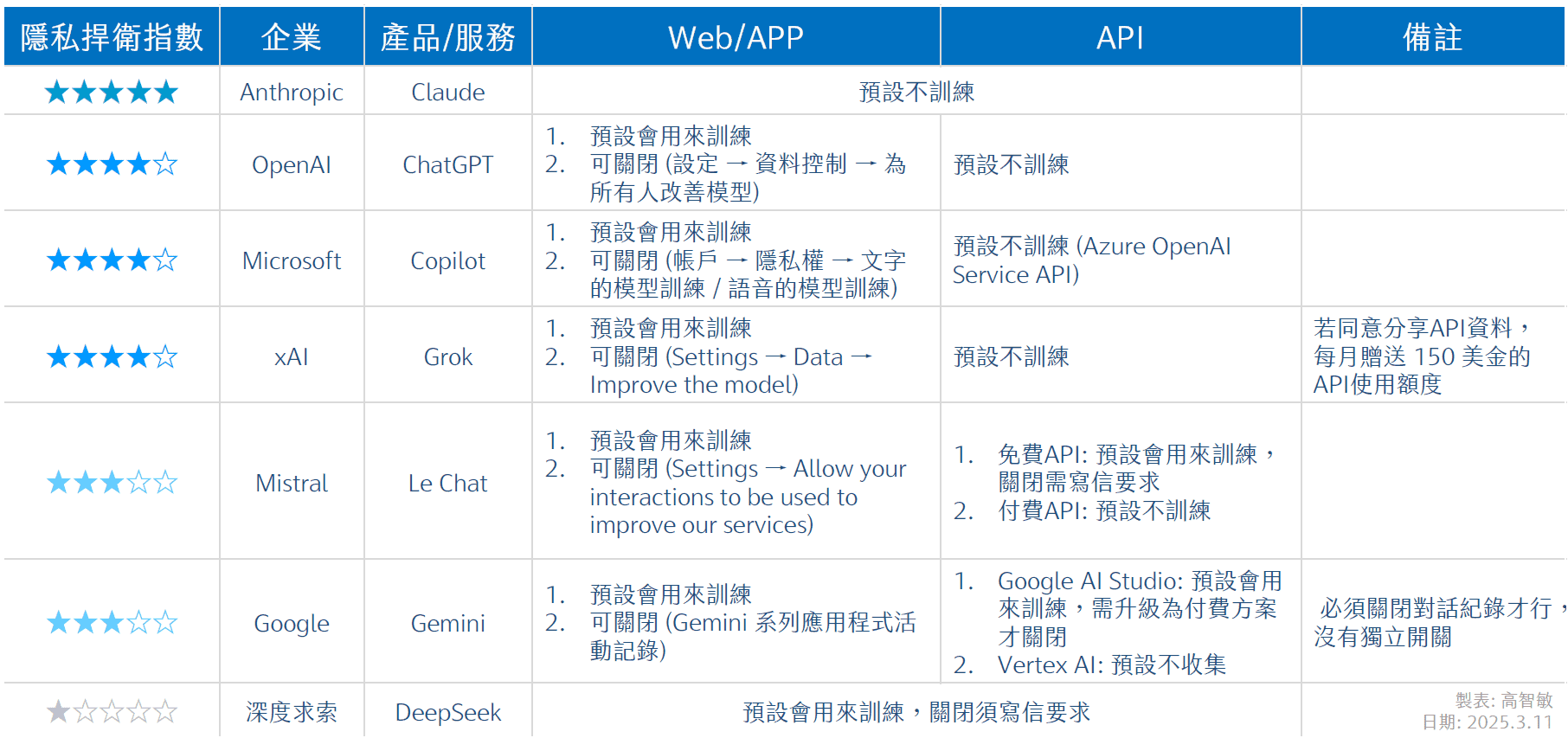

簡單來說,目前LLM廠商隱私保護概況如下:

- 免費使用的大語言模型,幾乎預設都會將對話紀錄用於次世代模型的訓練,畢竟絕頂聰明的菁英不會行光合作用、顯卡算力無法靠愛發電,這一切都需要白花花的銀子。免費使用的背後,必須建立在交換寶貴對話紀錄的條件上。

- 付費狀況就完全不同了。幾乎所有提供企業版本的LLM大廠,都會跟客戶保證絕不拿他們的資料來訓練模型;透過API使用LLM時(多半是程式直接介接溝通),付費版本的資料也不會被訓練。

- 多數廠商皆允許使用者關閉這樣的訓練機制,只不過難易程度不一罷了。

隱私捍衛指數:誰是英雄,誰是小偷?

如果可以把這些AI捍衛隱私的形象擬人化,大概可以粗略分為以下四級:

★★★★★:英雄級-不用特別提醒,一眼都不瞧你的秘密(Claude)

不愧是AI界的道德標竿,當競爭對手默默收集資料時,王者Anthropic依舊堅持原則,繼續走自己孤獨但不孤單的路。

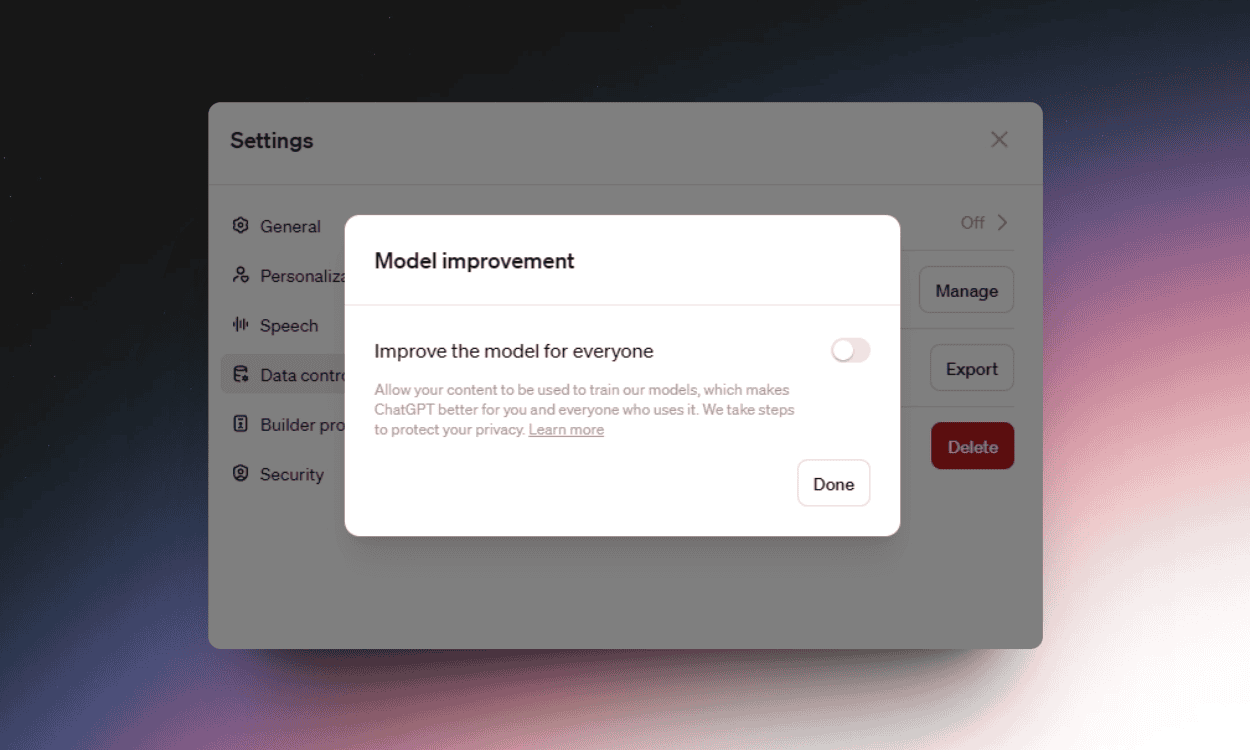

★★★★☆:好人級-絕不看API,其他你說不看它就不看(ChatGPT、Copilot、Grok)

雖然無法望Anthropic項背,但OpenAI、Microsoft、xAI在收集資料之餘,也給出了簡易的關閉方式,同時亦不使用API的資料,值得四星鼓勵。

★★★☆☆:凡人級-不看API得有條件,其他你不給看就算了(Le Chat、Gemini)

Mistral與Google雖然會收集也給出了簡易的關閉方式,不過要關閉API資料的使用卻稍嫌麻煩,只好扣一顆星。

★☆☆☆☆:小偷級-不看真的很難過,我考慮考慮(DeepSeek)

儘管曾經短暫風靡全球,CP值又高,不過看到DeepSeek什麼資料都要蒐集,要關閉還得特地寫郵件申請(還不一定通過核准),真的不敢放心使用。

詳細的對照表格如下。

如何保護自己的對話隱私?

如果需要處理的,是重要的公司機敏資料,外洩後果嚴重的那種,建議可考慮以下幾個方式:

- 不上傳、去識別:如果可以就不要上傳,如果真的要上傳請將重要資訊去識別化,甚至僅提供檔案的架構(如表頭)即可。

- 改企業、花下去:花錢升級為企業版,享受專屬的資料保護措施。

- 本地版、自己管:若一丁點外洩風險都無法承擔,那在公司內部自行架設LLM伺服器或私有雲,安裝如Meta Lllma的開源的LLM,保證資料不會外傳。

至於個人使用的話,選擇可以關閉訓練的LLM即可,畢竟挖空心思想知道你祕密的人真的不多。

參考資料

- How do you use personal data in model training, Anthropic Privacy Center

- How your data is used to improve model performance, OpenAI General FAQ

- Does Microsoft use my data to train AI models, Copilot Frequently asked questions

- Does xAI use my content for model training, xAI Consumer FAQs

- Mistral Privacy Policy

- What data is collected and how it’s used, Gemini Apps Privacy Hub

- DeepSeek Privacy Policy